こんにちは!ほけきよです٩( ᐛ )و

こんな記事を発見!!

NII(国立情報学研究所)が、くずし字のデータセットを公開したようです

今回は、その内容について詳しく紹介します

この記事を読むだけで

- どういうデータなの?

- サンプルコードどうやって動かすの?

がわかるので、興味がある方は是非

なんのデータなの?

現在収録されているのは下記の古典籍。いずれも料理のレシピ本みたいな感じです

2016年11月現在、日本古典籍字形データセットの規模は、 日本古典籍データセットの8点の画像データから切り取った くずし字1,521文字種の字形データ86,176文字です(文字種のリスト)。 2016年度中には約40万字に規模を拡大する計画ですので、どうぞご期待下さい。

ほう、ということは料理本意外もそのうち出てくるのかな??期待です

どういうデータなの?人間編

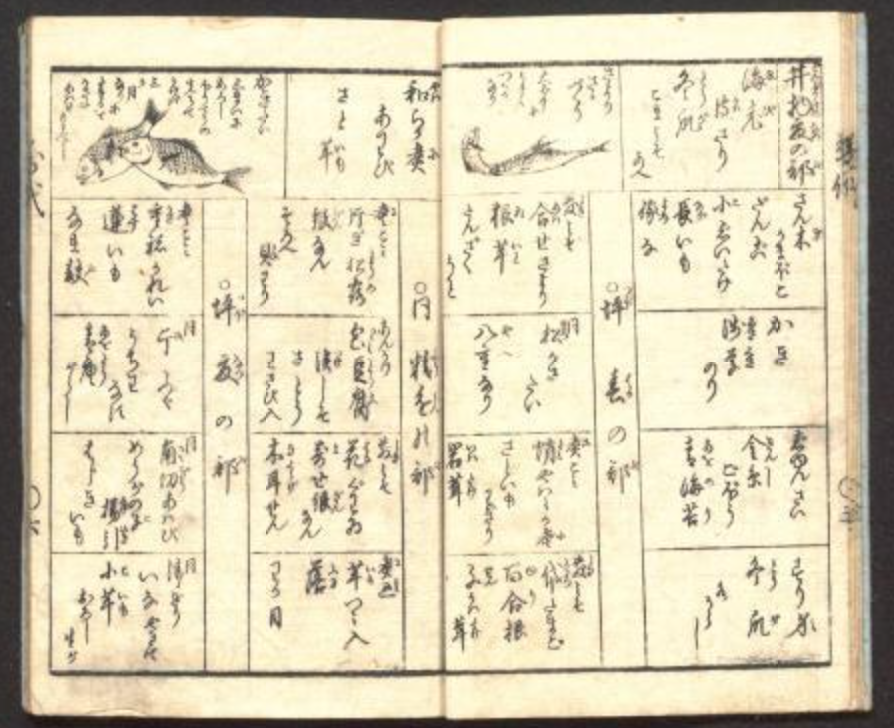

料理本、原本をスキャンしたやつを見ることができます。例えばさっきの画像の一番上にある「当世料理」

ここの,『 デジタル画像の閲覧(IIIF Curation Viewer)』というところで,原本のスキャンが見れます.こんな感じ

よ、読めぬい...

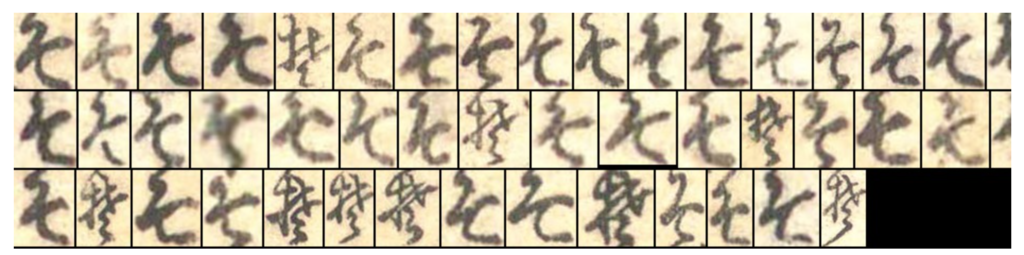

でも大丈夫、そんな人のために,『人間用学習データ』まで用意してくれています

すごい...!作った人たちの温かみを 画面越しに感じます!!!

これは『そ』だけをまとめたやつ.ほらほら,たまにお蕎麦やさんの暖簾に謎の文字あるでしょ?これ『きそば』と読むんですよ!(最近読めるようになった)

どういうデータなの?機械編

もちろん、機械学習用のデータセットなので、それ用のデータもございます

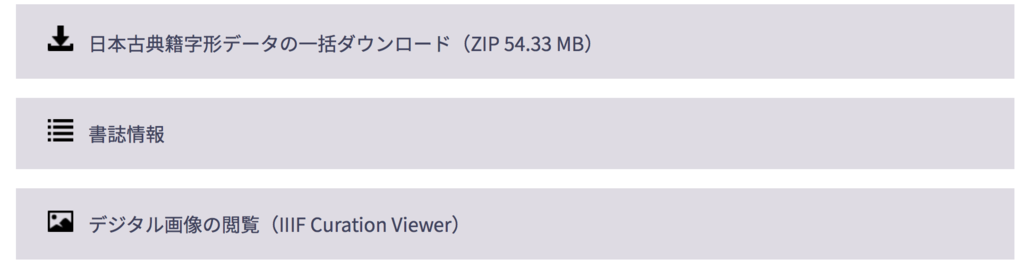

ダウンロード

この一番上のところからデータセットを落としましょう。

中身

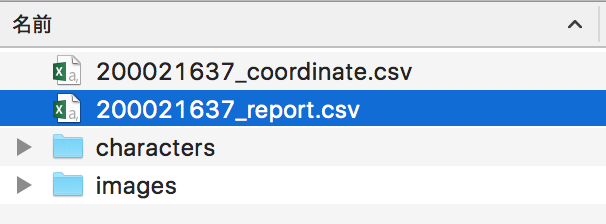

ファイルの構成は下記画像

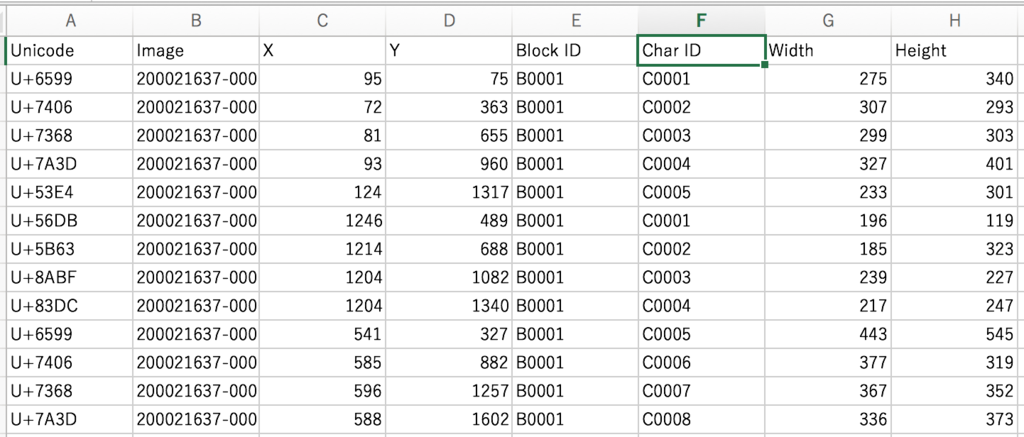

200021637_coordinate.csv

こんな感じのデータが入っている

どうやら,対象の文字と原本を対応させているもののようだ200021637_report.csv

読めなかった単語のリストとその理由のようcharacters

一文字一文字切り抜いた,温もり溢れる画像データimages

原本の画像

サンプルコードの使い方(手順説明)

なんと、大盤振る舞いであらかじめ画像認識のプログラムを配布してくれています!

下ページの最下部からサンプルコードを取得できます

必要な3つのモジュール

Keras

使っているのはKerasにあるMNISTのExampleコードのままらしい. なので,使うにはKerasをまずインストールしましょう.

pip install keras

でOK!

OpenCV

no module cv2

と怒られた.opencvがいるようだ.

macのhomebrewの人は↓コマンドでOKです

brew tap homebrew/science brew install opencv

h5pyのインストール

HDF5形式のファイルの読み書き(train_test_file_listがこの形式)に必要

pip install h5py

でOK

英語が苦手な人のため、Readmeを噛み砕く

あとはReadmeを読めばいいのですが、それもめんどいという人のために、READMEを要約(読める人はちゃんと読んでね)

- 使い方

python run.pyで実行- 基本的な設定をいじりたければ

config.pyをいじってね - データのロードのところをいじりたければ

load.pyをいじってね

- 何をやっているか

- もっともたくさん使われている文字10個を集めている(

train_test_file_list.h5に入っている.全部で23423枚の画像) - 10個の文字を正しく分類できるか

- データセットをtraining用85%とtest用15%に分割

- 画像を28*28にする→グレースケールにする

- Deeeeeeep Learningで学習する

- もっともたくさん使われている文字10個を集めている(

python run.py した

学習の結果。へえ〜Kerasってこんな感じで学習過程も見られるのね、分かりやすい

- lossとaccが,training用データの損失誤差と精度

- val_lossとval_accがtest用データの損失誤差と精度

94%で当てられるって。もうこれでいいやん…!

データ量が少ない文字でどうなるかが気になるところですね!狙うならそういう領域な気もします。

まとめ

昔から古文書とかには興味があって、俺得なデータセット様なので、 今後自分で改良して色々とやってみたいなと思ってます。

個人的にはVAEとかの生成モデルを使って、古典〜現代の字の変遷とか見れたら面白そうだな〜とか妄想中

皆さんもこの記事をよめば使えるはず! 是非是非使ってみてください!ではでは٩( ᐛ )و

関連書籍(ディープラーニングの実装系)

TensorFlowで学ぶディープラーニング入門 ~畳み込みニューラルネットワーク徹底解説~

- 作者: 中井悦司

- 出版社/メーカー: マイナビ出版

- 発売日: 2016/09/27

- メディア: 単行本(ソフトカバー)

- この商品を含むブログを見る

- 作者: 新納浩幸

- 出版社/メーカー: オーム社

- 発売日: 2016/09/09

- メディア: 単行本(ソフトカバー)

- この商品を含むブログを見る

ゼロから作るDeep Learning ―Pythonで学ぶディープラーニングの理論と実装

- 作者: 斎藤康毅

- 出版社/メーカー: オライリージャパン

- 発売日: 2016/09/24

- メディア: 単行本(ソフトカバー)

- この商品を含むブログ (14件) を見る